Stammdaten optimieren: Lösungsstrategien für die komplexe ERP-Datenverarbeitung

Warum Stammdaten in komplexen Lieferketten degenerieren

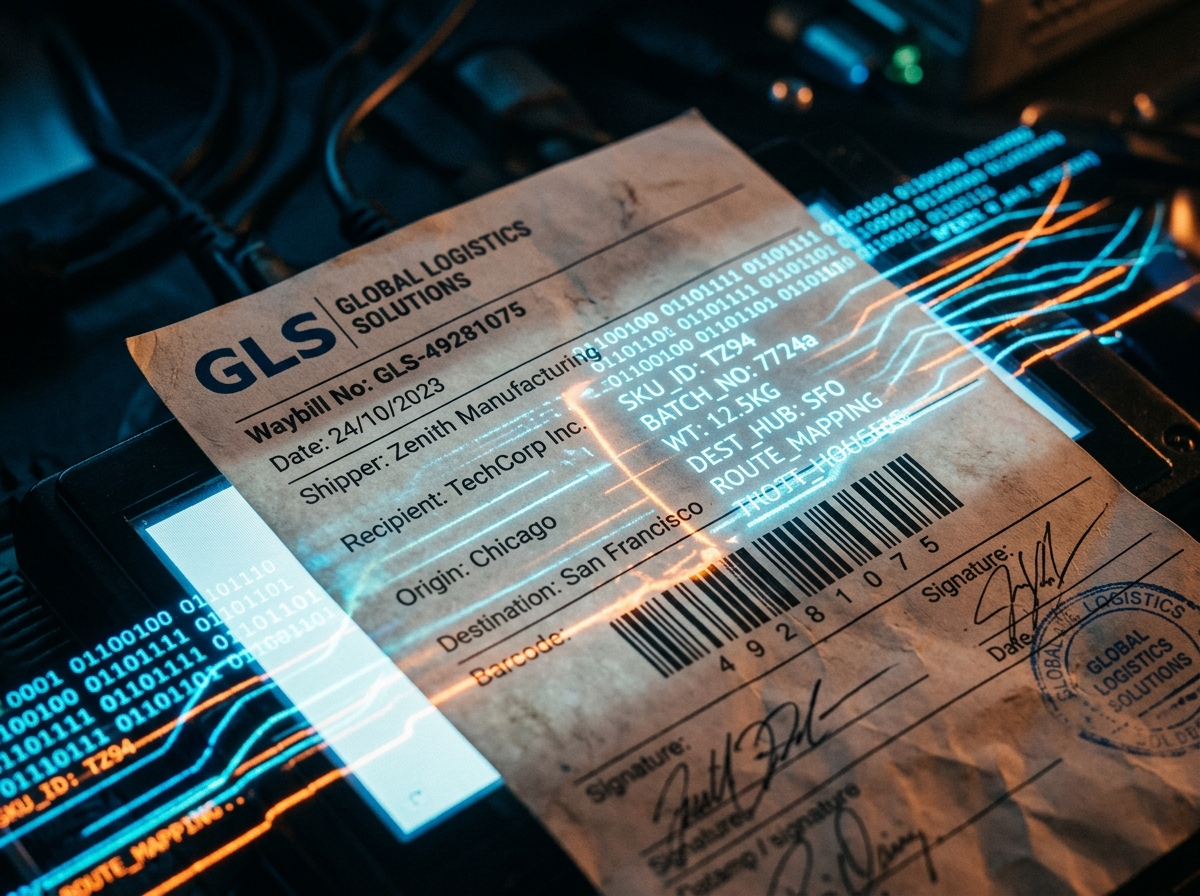

Ein unsauberes ERP-System hat seinen Ursprung direkt im operativen Tagesgeschäft. Operativer Druck und fragmentierte eingehende Datenströme bilden die Basis für die Degradation von Stammdaten (Master Data). Logistikketten sind auf Geschwindigkeit ausgelegt. Wenn Mitarbeiter täglich hunderte von Versanddokumenten, Rechnungen und Zollformularen unter Zeitdruck in ein System eintippen müssen, entstehen blinde Flecken. Für eine gesunde Unternehmensführung ist eine präzise Datenverarbeitung – DataMondial essenziell, um diese Fehler im Keim zu ersticken. Das Ziel verschiebt sich an der Front oft von der absolut korrekten Eingabe hin zur schnellen Abwicklung, um die logistischen Abläufe nicht zu verzögern.

Diese strukturellen Kompromisse bei der ERP-Datenverarbeitung führen schnell zu Duplikaten, Tippfehlern und ausgelassenen Feldern. Was als operative Notlösung („Workaround“) in der Dispositionsabteilung beginnt, wächst sich zu einem fundamentalen Problem für die Geschäftsführung aus. Fehlerhafte Stammdaten führen zu trägen und unzuverlässigen Managementinformationen. Entscheidungen über Kapazitäten, Einkauf und finanzielle Prognosen basieren dadurch auf einer verzerrten Realität. Risikoreduktion und Kostenkontrolle erfordern jedoch ein System, dessen Quelldaten ausnahmslos stimmen.

Variabilität in eingehenden Datenquellen

Jedes Glied in der Supply Chain nutzt eigene Formate. Lieferanten senden PDF-Rechnungen mit abweichenden Layouts. Seefrachtspediteure kommunizieren über unstrukturierte E-Mails. Zollportale erfordern spezifische XML- oder EDI-Schnittstellen, während Fahrer am Terminal physische CMR-Frachtbriefe in Papierform einreichen.

Ein modernes Warehouse Management System (WMS) oder Enterprise Resource Planning (ERP)-Portal baut auf starren, relationalen Datenstrukturen auf. Die Variabilität der eingehenden Quellen kollidiert massiv mit diesen strengen Feldanforderungen. Da ein standardisierter elektronischer Datenaustausch (EDI) über die gesamte Lieferkette hinweg in der Praxis oft unerreichbar bleibt, stellt die Übersetzung von der externen Quelle in das interne System ein ständiges Hindernis für saubere Datenstrukturen dar. Diese Vielfalt erzwingt bei der Dokumenten- oder ERP-Datenverarbeitung fast immer einen manuellen Zwischenschritt.

Die Falle manueller Korrekturen unter Zeitdruck

Stillstehende Logistik kostet unmittelbar Geld. Wenn ein LKW auf seine Freigabe wartet oder ein Schiff abfahrbereit liegt, erhält der physische Betrieb strikte Vorfahrt vor der administrativen Präzision. Backoffice-Mitarbeiter füllen Pflichtfelder in der Eile aus oder verwenden Dummy-Daten, um einen Prozess im ERP-System gewaltsam den Weg freizumachen. Diese reaktive Arbeitsweise verhindert zwar kurzfristige Verzögerungen, beschädigt jedoch die langfristige Datenarchitektur.

Im Laufe der Zeit häufen sich diese schnellen Notlösungen an. Das System füllt sich mit inkonsistenten Lieferantennamen, fehlenden Gewichtsspezifikationen und falschen Währungsangaben. Die Degradation verläuft schleichend. Eine Datenbank mit hunderttausenden verunreinigten Datensätzen nachträglich zu bereinigen, anstatt von Beginn an auf eine korrekte ERP-Datenverarbeitung am „Eingangstor“ zu setzen, erfordert Hunderte von Stunden an Datenbereinigung.

Lösung 1: Vollständige Automatisierung durch RPA

Der Einsatz von Robotic Process Automation (RPA) zielt darauf ab, den manuellen Faktor vollständig zu eliminieren. Bots replizieren die Handlungen eines menschlichen Nutzers über die bestehenden grafischen Benutzeroberflächen. Sie öffnen E-Mails, laden Anhänge herunter, kopieren Text und fügen diesen in die korrekten ERP-Felder ein. RPA erfordert eine erhebliche Investition in der Vorbereitungsphase, die sich auf die schrittweise Kartierung der operativen Prozesse, das Schreiben von Skripten und den Aufbau von Fehlerbehebungsprotokollen konzentriert.

Softwarebasierte Lösungen funktionieren innerhalb strikt definierter Regeln optimal. Skalierbarkeit ist die primäre Eigenschaft einer Bot-Infrastruktur; ist sie einmal programmiert, sind die marginalen operativen Kosten pro zusätzlich verarbeitetem Dokument äußerst gering. Allerdings bildet die Abhängigkeit von vollständig strukturierten Daten die harte Grenze. Sobald die eingehenden Variablen außerhalb der vordefinierten Parameter liegen, bricht der Prozess ab.

Operative und finanzielle Vorteile in der Skalierung

RPA verarbeitet vorhersehbare, repetitive Datenströme deutlich schneller als jedes Backoffice-Team. Ein Bot arbeitet ohne Pausen und macht keine Tippfehler, solange die Quelldaten lesbar und strukturiert sind. Für Organisationen, die täglich Tausende von standardisierten Dokumenten – wie beispielsweise elektronische Bestellungen mit festen XML-Strukturen – erhalten, senkt eine vollständige Automatisierung die Betriebskosten sofort.

Die Grenzen von RPA bei unstrukturierten Logistikdaten

Die Automatisierung scheitert bei Abweichungen. Unternehmen in der Logistik erhalten täglich handschriftliche Notizen auf Lieferscheinen, gescannte PDFs mit Kaffeeflecken oder Rechnungen von Lieferanten, die unerwartet ihr Layout ändern. RPA-Systeme können diese unstrukturierten Daten nicht interpretieren. Bei der kleinsten Abweichung meldet der Bot einen Ausnahmefehler („Exception Error“). Das spezifische Dossier erfordert dann in jedem Fall menschliche Intervention. Dieser Wiederherstellungsprozess kostet oft mehr Zeit, als wenn das komplexe Dokument von vornherein manuell verarbeitet worden wäre.

Lösung 2: Skalierung des internen Backoffice-Teams

Kapazitätsengpässe lokal durch die Einstellung zusätzlichen Personals zu lösen, ist ein weit verbreiteter Reflex. Die Beibehaltung der Dateneingabe und der Backoffice-Prozesse innerhalb der eigenen Wände vermittelt ein Gefühl der Kontrolle. Die interne Belegschaft besitzt Domain-Wissen und kennt die spezifische Kundennische. Menschliche Validierung fängt die oft unvorhersehbare Natur von Frachtdokumenten auf. Ein Mitarbeiter erfasst den Kontext einer unklaren E-Mail und erkennt in einem Ladelistendokument sofort Fehler, die ein Bot übersehen würde.

In der Praxis stoßen Unternehmen jedoch auf harte Markthürden. Der Arbeitskräftemangel in der Logistikbranche schränkt die Expansionsmöglichkeiten massiv ein. Rekrutierungsprozesse für administratives Personal ziehen sich über Monate hin, was die strukturelle Knappheit auf dem Arbeitsmarkt widerspiegelt.

Flexibilität durch direkten lokalen Austausch

Lokale Teams reagieren bei komplexen Dossier-Ausnahmen schnell. Ein Backoffice-Mitarbeiter geht physisch zum Zollanmelder oder Disponenten, um eine Unklarheit zu beheben. Diese direkte Abstimmung fördert Flexibilität. Die gemeinsame Besprechung und Korrektur von Daten gewährleistet die Berücksichtigung des lokalen Kontexts – unverzichtbar bei eiligen Sendungen mit fehlender Dokumentation.

Aktuelle Barrieren: Personalbeschaffung und Datenmüdigkeit

Kostenintensive Rekrutierungsrunden bremsen das Wachstum. Die Gehaltsforderungen steigen infolge der vorherrschenden Arbeitskräfteknappheit. Diejenigen, die für monotone und standardisierte Dateneingaben eingestellt werden, erleben zudem schnell eine sogenannte „Datenmüdigkeit“. Acht Stunden pro Tag Frachtinformationen abzutippen und zu validieren, führt zu mentaler Erschöpfung und Demotivation. Paradoxerweise führt genau dies – durch Konzentrationsverlust – zu einer hohen Personalfluktuation und neuen Fehlerquoten in der ERP-Datenbank.

Lösung 3: Hybride Datenverarbeitung durch EU-Nearshoring

Business Process Outsourcing (BPO) bietet eine rationale Alternative zur Kapazitätsfrage – vorausgesetzt, es ist richtig strukturiert. Das hybride Modell kombiniert Automatisierung und KI für den ersten Datenfilter mit der Denkkraft hochqualifizierter Fachkräfte für die Validierung und Ausnahmebehandlung. Eine effektive BPO-Lösung für Stammdaten positioniert die menschlichen Validierungsteams an einem kosteneffizienten europäischen Standort (wie Rumänien).

Im Gegensatz zu traditionellen Offshore-Routen Richtung Asien garantiert ein Nearshoring innerhalb Europas 100%ige EU-Compliance und die strikte Einhaltung des DSGVO-Rahmens für Datenschutz und Datensicherheit. Eine solche Partnerschaft erfordert zwar eine anfängliche Übergangsphase, um Prozesse zu definieren und Systeme einzurichten. Danach jedoch ermöglicht dieses Modell eine reibungslose Skalierbarkeit. Saisonal bedingte Schwankungen in den Frachtvolumina fängt das Nearshore-Team nahtlos auf, ohne jeglichen administrativen Druck auf die unternehmensinterne Lohn- und Gehaltsabrechnung auszuüben.

Die Synergie zwischen Technologie und menschlicher Qualitätssicherung

Eine isolierte Automatisierung („Stand-alone“) scheitert an der 100-prozentigen Verarbeitung logistischer Dokumente. Der hybride Ansatz löst dieses Problem. OCR (optische Zeichenerkennung) und KI extrahieren die nutzbaren Daten aus den Eingangsquellen. Das dedizierte Nearshore-Team bearbeitet die verbleibenden Ausnahmen, validiert den Output und füllt durch Fachwissen und Erfahrung fehlende Logistikfelder auf. Diese Konstruktion minimiert die Betriebskosten und sichert einen Benchmark in der Datengenauigkeit, den weder Software noch interne Teams im Alleingang erreichen.

Checkliste: Eignen sich Ihre Supply-Chain-Daten für Nearshoring?

Bestimmte Variablen deuten darauf hin, wie effektiv ein europäisches BPO-Modell für Ihre spezifische ERP-Datenbank sein kann:

- Es besteht ein strukturell hohes Volumen an physischen und digitalen administrativen Dokumenten.

- Die Daten weisen eine stark variierende Struktur auf (unterschiedliche Formate je Lieferant).

- Der Schutz der Unternehmensdaten unterliegt zwingend den Rahmenbedingungen der europäischen Datenschutzrichtlinien (DSGVO).

- Es gibt einen Bedarf an Verarbeitung und Validierung in derselben Zeitzone, abgedeckt in mehreren europäischen Sprachen.

- Unternehmenswachstum führt naturgemäß zu Spitzen und Tiefen im Datenvolumen.

Entscheidungsrahmen: Welche Strategie passt zu Ihrer Organisation?

Die Entscheidung für ein effektives Stammdatenmanagement erfordert einen nüchternen Blick auf zwei Säulen: Datenvolumen und Dokumentenkomplexität (strukturiert vs. unstrukturiert). Kleinere Organisationen mit geringem Dokumentenaufkommen, die stark von informellen internen Prozessen abhängig sind, profitieren oft noch davon, lokale Arbeitskräfte beizubehalten. Wenn die Volumina jedoch steigen, zwingen operative Flaschenhälse Unternehmen zu der Entscheidung zwischen reiner Technologie oder einer hybriden Sicherstellung innerhalb Europas.

Vergleichstabelle: Strategien für das ERP-Datenmanagement

| Strategie | Implementierungszeit | Garantie der Datenqualität | Kostenkontrolle |

|---|---|---|---|

| RPA (Vollautomatisierung) | Lang (Komplexes Set-up) | Mäßig bis hoch (Systemabstöße bei Ausnahmen) | Sehr effizient bei hohen, strukturierten Volumina |

| Internes Team skalieren | Lang (Träger Rekrutierungsprozess) | Hoch, jedoch anfällig für „Datenmüdigkeit“ | Niedrig (Hohe Personalkosten und Fluktuationsrisiko) |

| Hybrides Nearshoring (EU) | Mittel (Prozesskartierung und Transition) | Strukturell hoch (inklusive Human-in-the-loop Validierung) | Hoch (Flexible Kapazitäten, geringere Stundenlöhne) |

Die Strategiefindung basierend auf dem Logistikvolumen

Organisationen, die Millionen von Datenpunkten verarbeiten, stehen vor einer klaren Wahl. Ein hohes Volumen an 100 % strukturierten Daten verlangt nach einem Software-Pfad via RPA. Ist das Volumen gering und eine enge Zusammenarbeit mit dem Lager vor Ort zwingend erforderlich, wiegt der Vorteil eines festen Inhouse-Teams am schwersten. Verwalten Sie jedoch ein mittleres bis hohes Volumen an komplexen, unstrukturierten logistischen Eingängen (handschriftliche Frachtbriefe, Zolldokumente in wechselnden Formaten)? Dann bietet ein hybrides Nearshoring-Modell in Europa die nötige Sicherheit und Wirtschaftlichkeit.

Entscheiden Sie sich für robuste, stimmige Stammdaten, um Ihre Geschäftskontinuität zu wahren – ohne Einbußen bei der Flexibilität. Entdecken Sie, wie die hybriden BPO-Rahmenstrukturen von DataMondial Ihre operativen Abläufe durch eine zuverlässige ERP-Datenverarbeitung aus Rumänien entlasten. Wenn Sie die Präzision Ihrer Systeme langfristig sichern möchten, ist professionelle Datenverarbeitung – DataMondial der logischste nächste Schritt. Stellen Sie unsere Datenspezialisten unverbindlich vor Ihre spezifische Herausforderung, um den passenden Effizienzsprung für Ihre Organisation zu definieren.