Versteckte Kosten durch inkonsistente Datenstrukturen in Ihrem Beschaffungs-ERP aufdecken

Wie fehlerhafte Artikeldaten den Zahlungszyklus blockieren

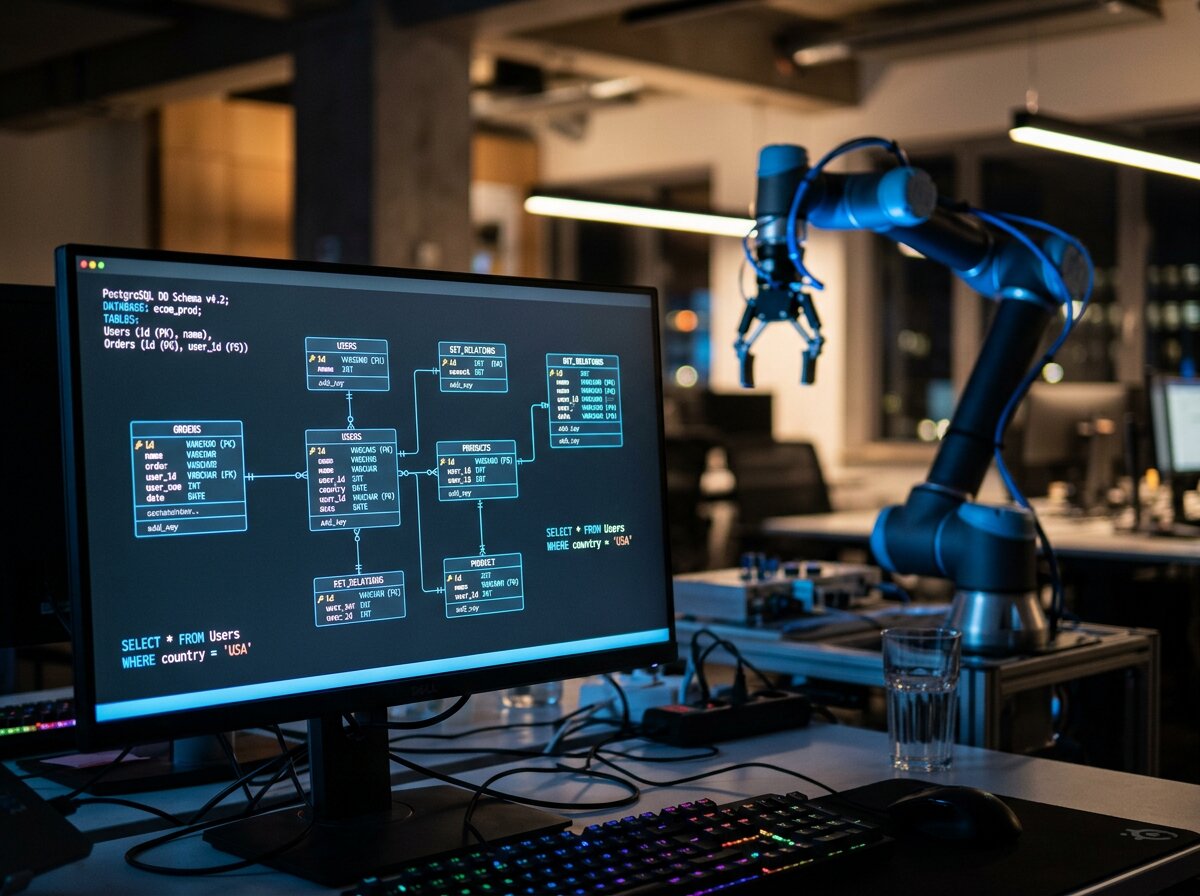

Operationelle Verzögerungen und direkte finanzielle Einbußen in Supply Chains haben ihren Ursprung oft in scheinbar unbedeutenden Abweichungen innerhalb der Stammdaten. Ein simpler Tippfehler in der Einkaufsabteilung löst eine Kaskade von Blockaden in der Finanzbuchhaltung und im Versand aus. Das Fundament eines reibungslosen Procure-to-Pay (P2P)-Prozesses setzt zwingend voraus, dass die Daten auf einer Bestellung exakt mit den Angaben auf der Eingangsrechnung und dem tatsächlichen physischen Wareneingang übereinstimmen. Sobald in diesem Dreieck Unstimmigkeiten auftreten, gerät der Zahlungszyklus ins Stocken. Eine professionelle Datenverarbeitung ist daher unerlässlich für die Kontinuität Ihrer Geschäftsprozesse.

Eine häufige Störungsquelle resultiert aus Diskrepanzen bei den erfassten Maßeinheiten (Unit of Measure). Beispielsweise wird eine Bestellung im ERP-System auf Basis von Einzelstücken angelegt, während der Lieferant die dazugehörige Rechnung auf Paletten oder Kolli stützt. Das System meldet einen Datenkonflikt und blockiert den automatischen Zahlungslauf umgehend. Diese Blockade erfordert zeitaufwändige manuelle Eingriffe: Die Mitarbeiter der Rechnungsprüfung müssen den Vorgang manuell prüfen, die Einkaufsabteilung bezüglich der vereinbarten Einheiten konsultieren, in die Kommunikation mit dem Lieferanten eintreten und den Umrechnungsfaktor im System händisch korrigieren. Diese ungeplanten Tätigkeiten treiben die Prozesskosten pro verarbeiteter Rechnung in die Höhe, verlängern die Durchlaufzeiten massiv und führen letztlich zum Verlust wertvoller Skonti.

Im Umschlag und Transportwesen übersetzen sich fehlerhafte Artikeldaten unmittelbar in handfeste Verluste. Eine inkorrekte Erfassung von Gewicht oder Volumen in Kubikmetern (CBM) in den Master Data wirkt sich direkt auf die Ladeplanung aus. Wenn ein Artikel im System mit 0,5 CBM statt der tatsächlichen 0,05 CBM registriert ist, kalkuliert die Planungssoftware einen Seecontainer oder LKW als voll, obwohl er in der Praxis weitgehend leer bleibt. Das Unternehmen zahlt folglich viel Geld für den Transport von reiner Luft.

Der Dominoeffekt von CBM- und Gewichtsabweichungen

Ein administrativer Tippfehler in den CBM- oder Gewichtsfeldern der Stammdaten fungiert als Auslöser eines äußerst kostspieligen Dominoeffekts. Eine suboptimale Containerbeladung erhöht die Transportkosten pro beförderter Einheit beträchtlich. Weisen die Daten ein zu geringes Volumen aus, wird entsprechend zu wenig Transportkapazität reserviert. In diesem Szenario bleiben die Waren schlichtweg an der Laderampe stehen. Dieser ungeplante Rückstand zwingt zu teuren Ad-hoc-Notfallmaßnahmen, wie der Buchung von Express- oder Luftfrachtsendungen, um vertragliche Lieferfristen noch einzuhalten. Die Transportkosten steigen dadurch weit über die im Beschaffungs-ERP kalkulierten Margen hinaus.

Warum ERP-Implementierungen das Datenproblem lediglich kaschieren

Neue Software oder modernste Prozessautomatisierungen führen nicht automatisch zu einer höheren Datenqualität. Unternehmen betrachten eine ERP-Migration fälschlicherweise oft als Heilsbringer und Endstation für ihre generellen Datenprobleme. In der Realität modernisiert ein neues System historische Datenverunreinigungen lediglich und verschiebt diese schlichtweg schneller zwischen den einzelnen Abteilungen. Der Fokus des Managements muss sich vom reinen Softwarepaket hin zum zugrundeliegenden, menschlichen Dateneingabeprozess verlagern.

Das manuelle Übertragen und Eingeben von Daten unter immensem Zeitdruck innerhalb einer dynamischen Supply Chain führt zu unvermeidbaren Erfassungsfehlern. Die utopische Vorstellung einer zu 100 % fehlerfreien manuellen Eingabe ohne strikte Systemvalidierungen und externe Qualitätskontrollen führt unweigerlich zu fehlerhaften Geschäftsprozessen. Unternehmen, die Budgets in teure Automatisierungslösungen investieren, dabei aber die dringend nötige Bereinigung ihrer Stammdaten überspringen, errichten letztlich nur eine hochmoderne Hülle um einen unbrauchbaren Kern. Schneller ausgeführte IT-Prozesse generieren schlichtweg schneller Fehler, wenn der Rohinput korrupt ist.

Der blinde Fleck der Robotic Process Automation (RPA)

Automatisierungstechnologien wie RPA (Robotic Process Automation) sind darauf programmiert, Transaktionen rasant auf der Grundlage vordefinierter Regeln zu verarbeiten. Der blinde Fleck eines Software-Roboters ist jedoch seine absolute Unfähigkeit, die Logik verunreinigter Basisdaten infrage zu stellen. Wenn die Stammdaten eine inkorrekte Preisstaffel oder einen falschen Währungscode enthalten, automatisiert RPA unhinterfragt die Ausführung dieser fehlerhaften Anweisungen. Eine RPA-Implementierung gerät ins Stocken oder erzeugt systematische Einkaufsfehler, solange eine streng kontrollierte und harmonisierte Datenbasis fehlt. Eine vollumfängliche Data Accuracy (Datengenauigkeit) ist eine Grundvoraussetzung, bevor sich Investitionen in Automatisierung wirklich rentieren.

Konkrete Margenverluste durch inkonsistente Lieferantenprofile

Die Fragmentierung von Lieferantenprofilen verursacht direkte finanzielle Einkaufsverluste und macht strategische Entscheidungen quasi unmöglich. In Logistik- und Beschaffungs-ERPs entstehen im Laufe der Jahre häufig doppelte Profile (Dubletten) für ein und denselben Lieferanten. Ein Unternehmen bestellt bei „Lieferant X“, Rechnungen werden jedoch auch unter „Lieferant X GmbH“ oder „Lieferant X International“ im System gebucht. Durch diese Zersplitterung wird das tatsächliche Einkaufsvolumen künstlich auf mehrere rechtliche Einheiten aufgeteilt.

Diese unübersichtliche Aufteilung hindert Einkaufsabteilungen massiv daran, Staffelrabatte und Volumenboni voll auszuschöpfen. Ein vertraglich vereinbarter Rabatt, der ab einer Abnahme von 10.000 Einheiten gilt, greift nicht, wenn das ERP-System fälschlicherweise registriert, dass 6.000 Einheiten über Profil A und 4.000 Einheiten über Profil B abgewickelt werden. Die Organisation kauft infolgedessen weiterhin zu veralteten, nicht mehr marktgerechten Preisen ein – schlichtweg, weil das aggregierte, tatsächliche Volumen als kritischer Hebel bei Vertragsverhandlungen fehlt. Verunreinigte Daten korrumpieren somit direkt die Spend-Analyse auf C-Level. Ein CFO oder COO stützt strategische Kostenkontrollen auf Berichte, die in der Realität ein völlig verfälschtes, fragmentiertes Bild der ausgehenden Zahlungsströme zeichnen.

Drei Indikatoren für verzerrte Logistik-Reportings durch Dateninkonsistenz

- Undefinierte Restkategorien in der Spend-Analyse: Fällt in Management-Reportings ein unerwartet hoher Prozentsatz der Einkaufsausgaben unter Bezeichnungen wie „Diverses“ oder „Sonstiges“, fehlen in der Regel die korrekten Master-Data-Kategorien oder Produktcodes bei den entsprechenden Lieferantenprofilen.

- Strukturelle manuelle Korrekturen bei Transportrechnungen: Eine hohe Fehlerquote mit negativen Abweichungen zwischen den im ERP vorkalkulierten Frachttarifen und der tatsächlichen Rechnung des Spediteurs deutet untrüglich auf strukturell inkorrekte Gewichts- oder Volumeneinheiten in den Stammdaten hin.

- Abweichungen bei der Lieferantenkonsolidierung: Analysereports weisen niedrige Bestellwerte aus, die auf eine ungewöhnlich hohe Anzahl von Lieferanten verteilt sind – ein klares Indiz für das Vorhandensein mehrfacher, nicht bereinigter Profile desselben physischen Handelspartners.

Die Grenzen interner Bereinigungsaktionen

Das Ad-hoc-Löschen von Bränden durch das interne Logistik- oder Finanzteam ist ein völlig ineffektiver Ansatz zur nachhaltigen Lösung von Master-Data-Problemen. Backoffice-Mitarbeiter verbringen wöchentlich unzählige Stunden damit, Vorfälle am Rande ihres eigentlichen Tagesgeschäfts zu beheben. Sie entsperren mühsam eine festgefahrene Einkaufsrechnung oder korrigieren manuell eine Ladeliste für eine konkrete Einzelsendung. Die fehlerhaften Quelldaten – der Artikel oder das Lieferantenprofil im ERP – bleiben davon jedoch völlig unberührt. Bei der nächsten identischen Bestellung oder Transportbuchung wiederholt sich exakt dasselbe Problem. Internen Teams fehlt schlichtweg die Kapazität, um tausende SKUs (Stock Keeping Units) strukturell und bereichsübergreifend zu harmonisieren, da die täglichen operativen Kernaufgaben berechtigterweise Priorität haben.

Ein Projekt aufzusetzen, um rückwirkend sämtliche Datenfelder im gesamten System zu bereinigen, ist völlig unrentabel und in der Praxis kaum durchführbar. Eine ERP-Datenbank enthält oftmals zahlreiche veraltete Artikel oder Lieferanten, die bereits seit Jahren inaktiv sind. Dies erfordert einen gezielten, methodischen Ansatz, um Master Data in ERP-Systemen strategisch zu optimieren. Indem das Fokusmanagement ausschließlich auf aktive Master Data und geschäftskritische Dimensionen (wie Preis, Gewicht, Volumeneinheit und korrekte Lieferantenidentifikation) angewandt wird, beschleunigt sich der Return on Investment (ROI) signifikant. Dieser pragmatische Ansatz trennt die ineffiziente Ad-hoc-Symptombekämpfung endgültig vom strukturellen, strategischen Datenmanagement. Er schafft verlässlich ein sauberes Fundament für datengesteuerte Prozesse und eine echte operationelle Skalierbarkeit im gesamten Unternehmen.

Korrekte Datenstrukturen bilden die unverzichtbare Grundlage für skalierbare, automatisierte und hochprofitable Supply Chains, während fehlerhafte Daten zu direkten und meist verdeckten Kosten in Transport und Beschaffung führen. Der internen Bereinigung historischer Master-Data-Verunreinigungen mangelt es jedoch allzu oft an Fokus und personeller Kapazität, weshalb eine externe, zielgerichtete Steuerung in puncto Data Accuracy (Datengenauigkeit) zwingend erforderlich ist. Als spezialisierter BPO-Partner übernimmt DataMondial dieses strukturelle Management der Datenverarbeitung für Sie – über eine professionelle, absolut sichere und vollständig EU-konforme Nearshoring-Struktur in Rumänien. Nehmen Sie über unsere Website direkt Kontakt auf oder erfahren Sie im Detail, wie wir Master Data in ERP-Systemen effizient strukturieren, um zu entdecken, wie wir Ihre Backoffice-Prozesse und zugrundeliegenden Datenstrukturen nachhaltig optimieren – ohne Ihre internen Kernteams zusätzlich zu belasten.